電子情報システム学科:知能情報処理研究室運営ページ

知能情報処理研究室

Intelligent Information Processing Laboratory

言葉、表情、動作、生体信号など様々な情報を介して、人間と環境を理解し、人間を知的に支援するための知能情報処理について研究を行なっています。特に、言葉を操る賢いコンピュータを作る自然言語処理、人間の表情・生体信号から感情を理解するヒューマンマシンインターフェイス、カメラなどの人工の「目」を用いて外界を認識・理解するコンピュータビジョン、言葉や身振りを使って人間と会話する会話ロボット等について研究を進め、生活支援・農業支援・健康支援などの応用分野における研究の活用にも取り組んでいます。

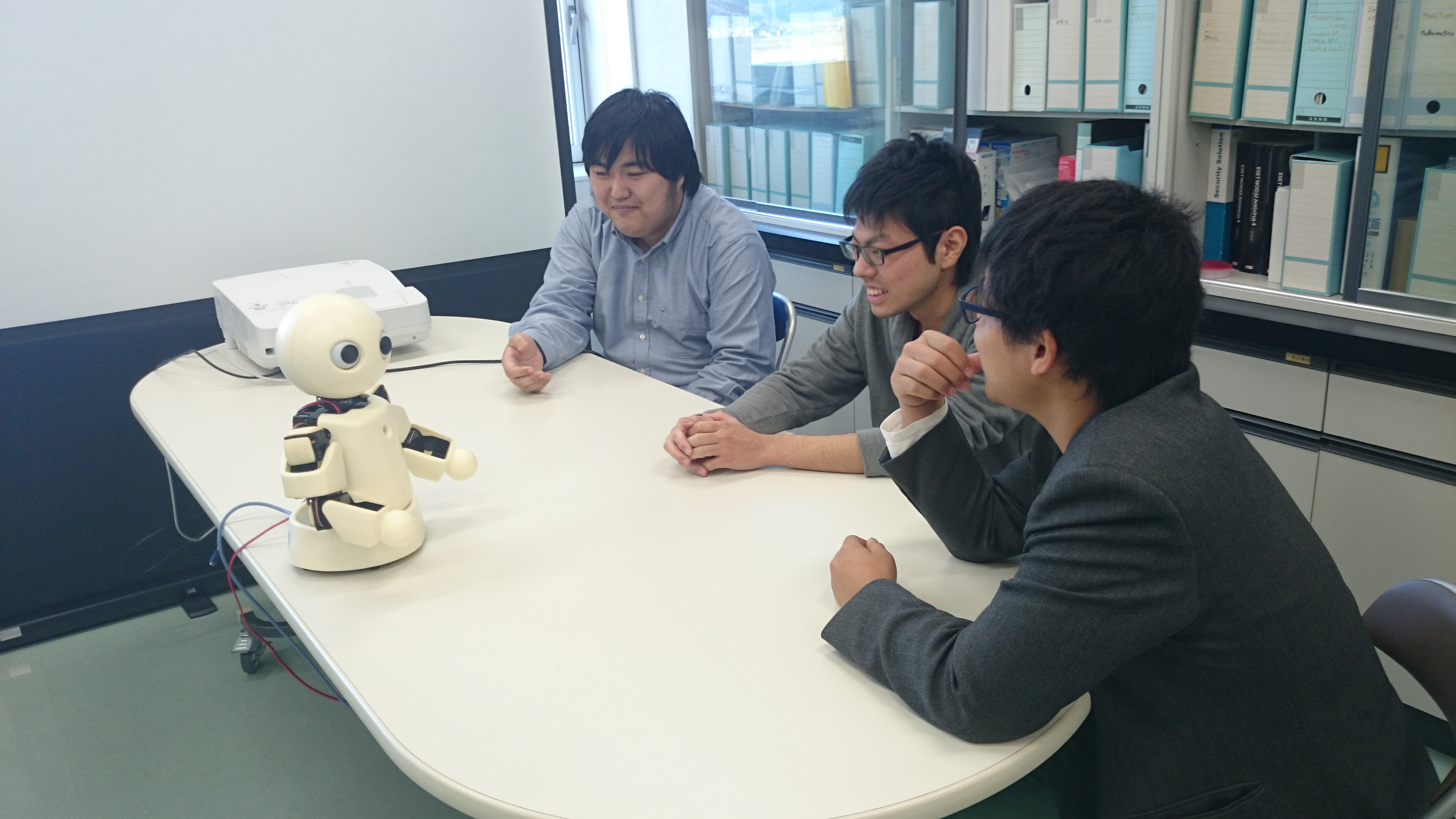

会話ロボット・自然言語処理

人間・コンピュータ間の親しみやすいコミュニケーション通して様々な人間活動を支援することを狙いとして,言葉・身振りなどの日常のコミュニケーション手段を使って人間と会話する会話ロボットに関する研究,人間の言葉を理解・生成するための自然言語処理技術の開発などを行っています.また,自然言語処理技術の高度化を目指して,「ロボットは東大に入れるか」プロジェクトに参加し,大学入試問題を解く方法の開発に取り組んでいます.

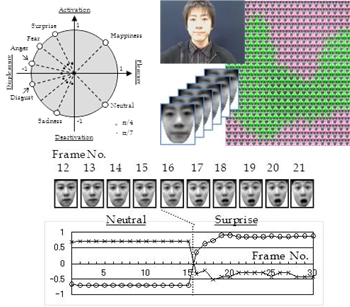

表情から相手の感情を認識するロボット

ヒューマン・マシン間の感情のコミュニケーションを目的とした顔表情の認識に関する研究を実施しています.人間の表情は多様であり,短期間ですべての表情パターンを学習データとして取得することは困難です.そこで,長期的な時間軸に対して高い頑強性を維持していくために,既存の知識を保持したまま,新たな知識を追加学習することが可能な適応型の表情認識モデルの確立を目指しています.また,顔表情から感情の程度を定量化するために,顔表情の物理的変化量と感情の心理的変化量の対応関係を表現する特徴空間の生成手法について検討しています.

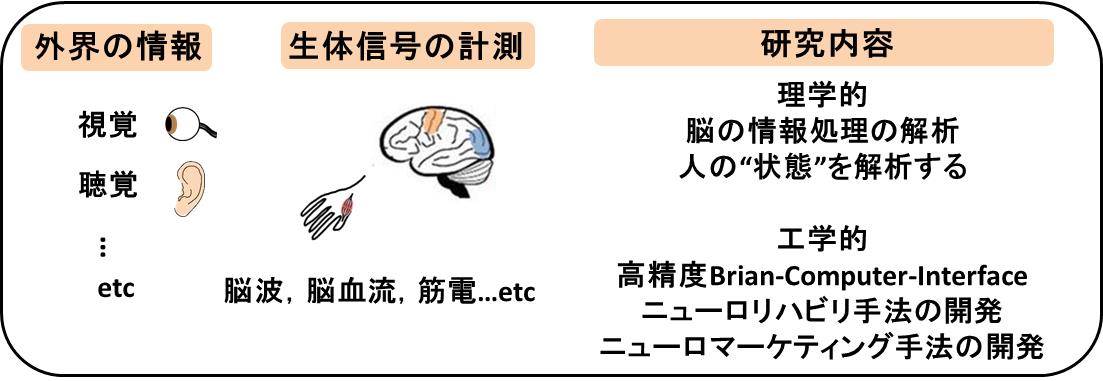

Brain-Computer Interface (BCI)

外界から入力された情報が脳でどのように処理されているのかを明らかにして,人間の活動を支援する技術を開発します.心理状態に依存したBrain-Computer Interface (BCI)-会話ロボットの開発,ストレス・疲労の評価手法の開発,ニューロリハビリ手法の開発などを行います.

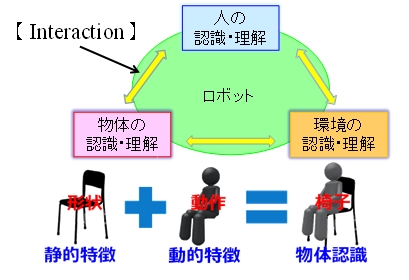

人間・物体・環境のインタラクションのモデル化

人間は物体を認識する際,その物体の使われ方,すなわち人と物体のインタラクションを特徴として用いていると考えます.本研究では人と物体とのインタラクションとしてアフォーダンスの概念を用いています(アフォーダンス=物体が有する機能的情報から人のどのような行動が誘発されるか,といった考え方).人と物体との相互関係(物体に対する人間の動作)を物体の属性特徴として抽出し,その属性情報を物体認識の特徴として利用する手法の確立を目指しています.

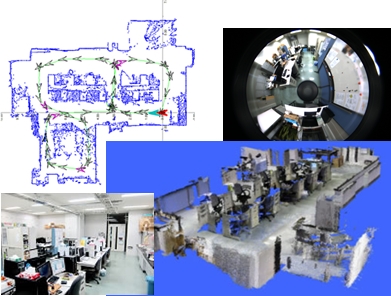

自律移動ロボットの環境地図構築と自己位置推定

自律移動ロボットには自己位置推定や環境地図構築,経路計画といった様々な要素技術が必要です.本研究では自己位置推定と環境地図構築を同時に行うSLAM(Simultaneous Localization and Mapping)に関する技術開発を行っています.具体的には,LRF(測域センサ)による2次元情報,周囲360°を撮影できる全方位カメラによる画像情報,RGB-Dカメラ(デプスセンサ)による3次元画像などを用いた種々のSLAM手法の実装・改善に取り組んでいます.

ICT・IoTを活用した農工連携

近年,農業就業人口の減少,担い手の高齢化が進んでいることから,高品質あるいは付加価値の高い農作物を経験や勘に頼ることなく生産できる手法の確立が求められています(農作業の知識化と自動化).当研究室では,農業分野にICT・IoT技術を積極的に活用することにより,農作物の品質判定を行うための収穫適期簡易判定システムや,農作業の操作系・動作系技能,判断系技能といった熟練ノウハウの伝承支援に係る技術開発を実施しています.

|